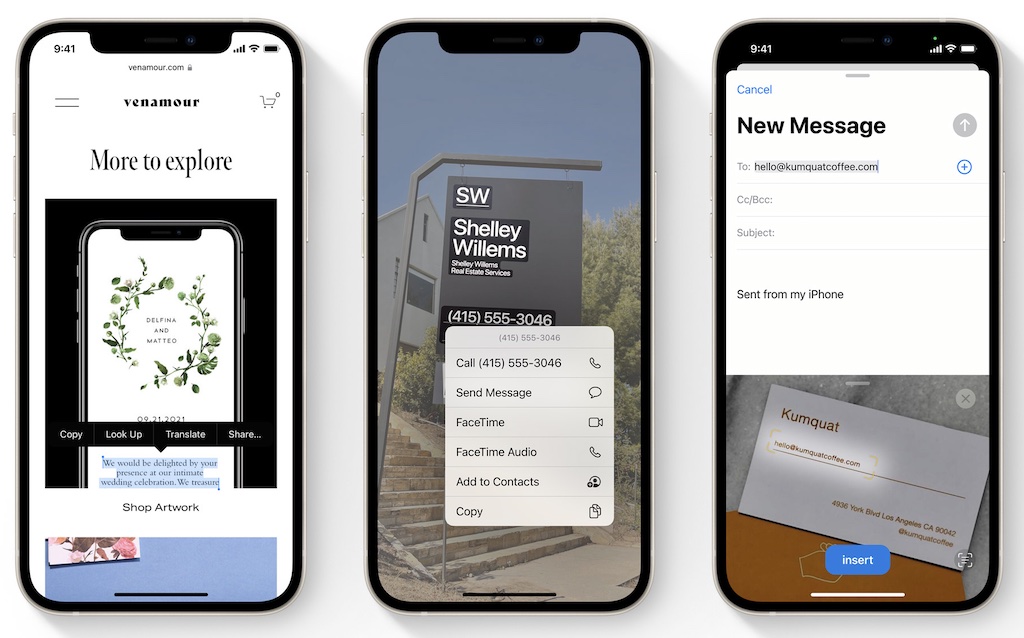

Neben den FaceTime-Neuerungen gehört für uns ganz klar „Livetext“ zu den Highlights von iOS 15 und iPadOS 15. Apple setzt auf On-Device-Intelligeznz, um Text und andere Gegenstände auf Fotos zu erkennen und diesen nutzen zu können. Wie das Ganze funktioniert, seht ihr im eingebundenen Video.

iOS 15: Livetext-Funktion im Video

Apple setzt verstärkt darauf, immer mehr Funktionen direkt auf einem Gerät auszuführen und nicht von Servern. Mit der On-Device Spracherkennung wird Audio von Siri Anfragen jetzt standardmäßig komplett auf dem iPhone verarbeitet. Hierfür wird ein iPhone oder iPad mit A12-Chip oder neuer benötigt.

Auch bei der Live-Text-Funktion setzt Apple auf die Verarbeitung direkt auf dem Gerät. Der Hersteller formuliert wie folgt:

Livetext nutzt On-Device Intelligenz, um Text in einem Foto zu erkennen und Anwender:innen das Ausführen bestimmter Aktionen zu ermöglichen. So können Nutzer:innen zum Beispiel nach dem Bild eines handgeschriebenen Familienrezepts suchen und es finden oder eine Telefonnummer in einem Schaufenster fotografieren und dort anrufen. Mit der Power der Apple Neural Engine kann die Kamera App auch schnell Text in einem bestimmten Moment erkennen und kopieren, beispielsweise das in einem Café angegebene Wi-Fi Passwort. Mit Visual Look Up können Nutzer:innen mehr über beliebte Kunstwerke und Sehenswürdigkeiten auf der ganzen Welt, Pflanzen und Blumen in der Natur und Tierarten erfahren — und sogar Bücher finden.

Apple selbst hat die Funktion im Rahmen der WWDC 2021 Keynote demonstriert. Das eingebundene Video gibt euch einen weiteren Einblick in Livetext.

Sie sehen gerade einen Platzhalterinhalt von Youtube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Sie sehen gerade einen Platzhalterinhalt von Facebook. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr InformationenSie sehen gerade einen Platzhalterinhalt von Instagram. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr InformationenSie sehen gerade einen Platzhalterinhalt von X. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Mehr Informationen

0 Kommentare